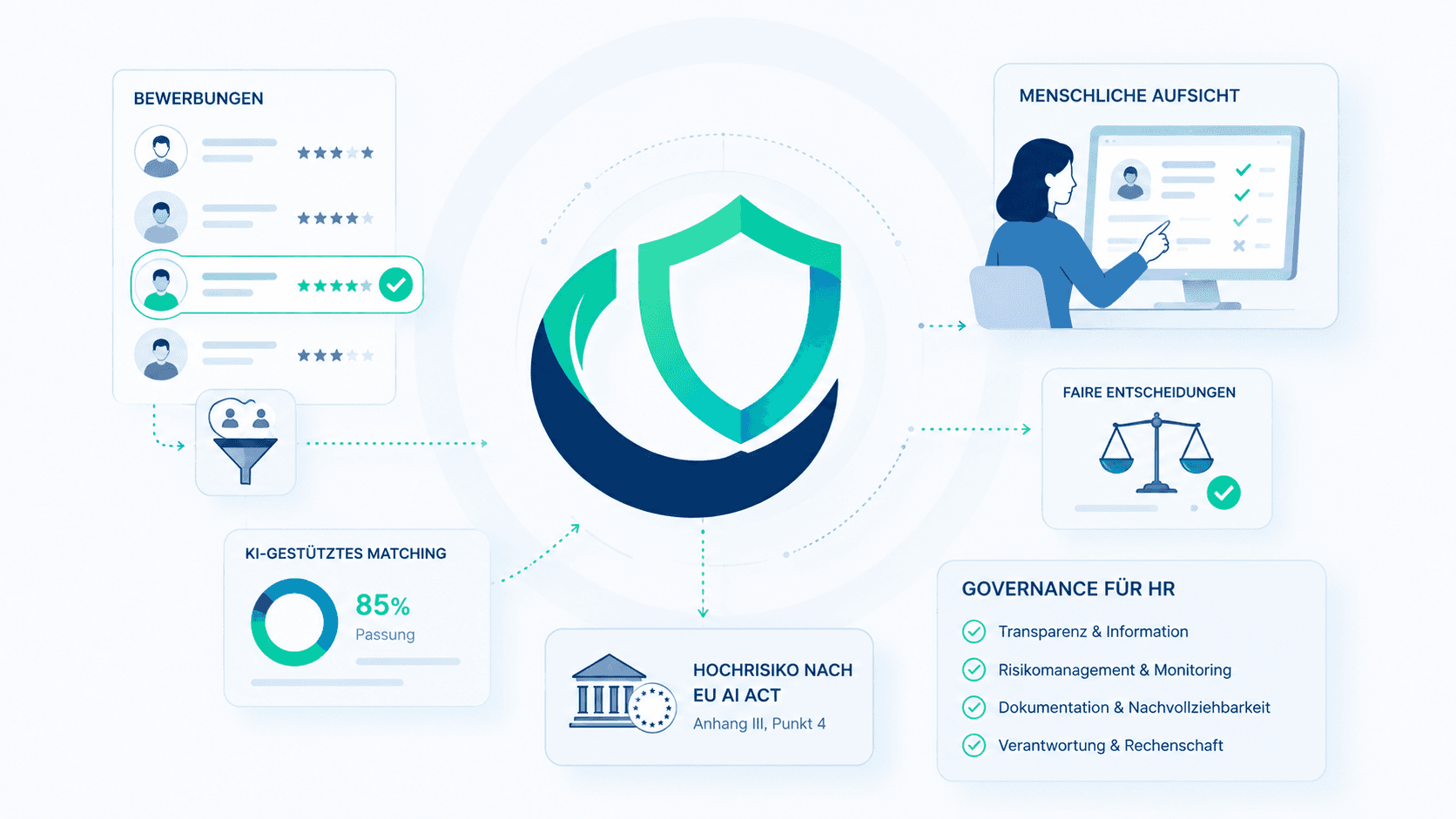

KI im Recruiting ist längst kein Pilotprojekt mehr. Bewerbungsfilter, automatisiertes Matching, Skill-Scoring, KI-gestützte Interviews und Empfehlungssysteme für Beförderungen oder Versetzungen sind in den meisten HR-Abteilungen bereits im Einsatz. Oft eingeführt, ohne dass die Geschäftsführung wusste, dass damit der Status eines „Hochrisiko-KI-Systems" nach EU AI Act ausgelöst wird.

Genau das ist der Fall. Anhang III, Punkt 4 der KI-Verordnung listet KI-Systeme in „Beschäftigung, Personalmanagement und Zugang zur Selbstständigkeit" ausdrücklich als Hochrisiko. Damit gehört HR neben Strafverfolgung, Migration und kritischer Infrastruktur zu den am stärksten regulierten Anwendungsbereichen der gesamten Verordnung.

Für die Personalleitung ist das mehr als eine Compliance-Frage. Es ist eine Führungsentscheidung. Wer welche Tools einsetzt, wer dafür verantwortlich ist, wie die Risiken zwischen HR, IT und Recht aufgeteilt werden, das alles wird in den nächsten Monaten zur Governance-Aufgabe der C-Ebene. Dieser Beitrag ordnet ein, was Anhang III Punkt 4 für die Personalleitung bedeutet und welche strategischen Entscheidungen jetzt anstehen.

Was Anhang III Punkt 4 konkret abdeckt

Der Gesetzestext ist in zwei Teile gegliedert, und beide treffen den HR-Alltag direkt.

Anhang III, Punkt 4(a): Recruiting und Auswahl

KI-Systeme für „die Einstellung oder Auswahl natürlicher Personen, insbesondere um zielgerichtete Stellenanzeigen zu schalten, Bewerbungen zu analysieren und zu filtern und Bewerber zu bewerten."

Anhang III, Punkt 4(b): Personalmanagement

KI-Systeme „um Entscheidungen zu treffen, die sich auf Bedingungen von Arbeitsverhältnissen, die Beförderung oder Kündigung von Arbeitsverhältnissen auswirken, oder um Aufgaben zuzuweisen, Leistung und Verhalten zu überwachen und zu bewerten."

Das ist breit gefasst und mit voller Absicht. Erwägungsgrund 57 der Verordnung erklärt warum: KI im Beschäftigungskontext kann „erheblichen Einfluss auf die künftigen Karrierechancen, den Lebensunterhalt der betroffenen Personen und die Rechte der Arbeitnehmer" haben. Genau das ist die Begründung für die Hochrisiko-Einstufung.

Welche Tools faktisch betroffen sind

Die Liste ist länger als die meisten HR-Abteilungen erwarten. Sobald ein System Kandidaten ranken, filtern, bewerten oder Empfehlungen für Personalentscheidungen geben kann, ist es im Anwendungsbereich.

Wichtig: Die KI muss nicht der alleinige Entscheider sein, damit die Hochrisiko-Einstufung greift. Bereits eine „materielle Beeinflussung" der Entscheidung (Ranking, Filterung, Scoring) reicht aus. Der oft zitierte „Mensch in der Schleife" entbindet nicht von der Hochrisiko-Klassifizierung, er ist Teil der menschlichen Aufsicht nach Art. 14, nicht ein Ausweg aus Anhang III.

Was sich für die Personalleitung konkret ändert

Die Einstufung als Hochrisiko-System löst eine ganze Reihe von Pflichten aus. Für die Personalleitung sind sieben Punkte besonders relevant:

Vollständiges KI-Inventar im HR-Bereich

Welche KI-Systeme sind in HR im Einsatz? Inklusive eingebetteter KI-Features in Bewerbermanagement, Lernplattformen, HRIS, People Analytics. Schatten-KI in HR ist besonders verbreitet, weil Tools oft fachlich beschafft wurden, ohne dass IT oder Compliance eingebunden waren.

Klare Verantwortlichkeit benennen

Wer ist verantwortlich für KI-Compliance im HR-Bereich? Personalleitung, Datenschutzbeauftragter, AI Officer, oder eine geteilte Verantwortung mit IT? Ohne klare Rolle bleibt die Verantwortung im Zweifel bei der Person, die ein Tool unterschreibt, und das ist selten dieselbe Person, die das Compliance-Risiko verstanden hat.

Anbieter strukturiert prüfen

Als Betreiber dürfen Sie Anbieter nicht blind vertrauen. Fragen Sie: Hat der Anbieter sein System als Hochrisiko eingestuft? Gibt es eine Konformitätserklärung? CE-Kennzeichnung? Eine Eintragung in der EU-Datenbank? Ein Anbieter, der bei diesen Fragen ausweicht, ist ein Risiko für Ihr Unternehmen.

Menschliche Aufsicht real machen

Art. 14 verlangt menschliche Aufsicht über Hochrisiko-KI. Im HR-Kontext heißt das konkret: Eine echte Person prüft Vorauswahl-Ergebnisse, kann sie überstimmen und tut das auch dokumentiert. „Der Recruiter hat das System gesehen" reicht nicht. Es muss erkennbar sein, dass und wie die menschliche Entscheidung das KI-Ergebnis beeinflusst hat.

Bewerber und Beschäftigte informieren

Art. 26 Abs. 11 verlangt, dass betroffene Personen über den Einsatz von Hochrisiko-KI informiert werden. Bei Bewerbern heißt das: ein Hinweis im Bewerbungsprozess, idealerweise bereits in der Stellenausschreibung. Bei Beschäftigten ist außerdem Art. 26 Abs. 7 zu beachten: Mitarbeiter und ihre Vertretungen müssen vor dem Einsatz informiert werden, unabhängig vom Vorhandensein eines Betriebsrats.

Grundrechte-Folgenabschätzung prüfen

Art. 27 verpflichtet bestimmte Betreiber, vor dem Einsatz eines Hochrisiko-Systems eine Folgenabschätzung für Grundrechte durchzuführen. Das gilt insbesondere für öffentliche Stellen und private Anbieter öffentlicher Dienstleistungen. Aber auch privatwirtschaftliche Unternehmen sollten prüfen, ob ihre bestehende Datenschutz-Folgenabschätzung nach Art. 35 DSGVO um KI-spezifische Aspekte erweitert werden muss.

Diskriminierungsrisiken aktiv managen

KI im Recruiting ist nicht nur ein AI-Act-Thema, sondern auch ein AGG-Thema. Eine fehlerhaft trainierte KI kann systematisch bestimmte Gruppen benachteiligen. Wenn das nachgewiesen wird, drohen Schadensersatzansprüche unabhängig vom AI Act. Die Personalleitung sollte mit der Rechtsabteilung klären, wie Bias-Tests, Audit-Protokolle und Reaktionsprozesse aufgesetzt werden.

Die strategischen Fragen für die Personalleitung

Aus diesen Pflichten ergeben sich auf C-Ebene drei Entscheidungen, die nicht delegiert werden können.

Frage 1: Wo ziehen wir die Linie zwischen Effizienz und Kontrolle?

KI kann den Recruiting-Prozess massiv beschleunigen. Sie kann aber auch zu Entscheidungen führen, die niemand mehr nachvollziehen kann. Wo liegt für Ihr Unternehmen die Balance? Ist die Beschleunigung um Wochen den Aufwand für menschliche Aufsicht wert? Und welche Entscheidungen werden bewusst „menschlich" gehalten, auch wenn KI sie schneller treffen könnte?

Frage 2: Wer trägt die Verantwortung im Ernstfall?

Ein KI-System trifft eine fragwürdige Entscheidung. Eine Bewerberin klagt wegen Diskriminierung. Die Bundesnetzagentur kündigt eine Marktüberwachungsprüfung an. Wer in Ihrem Unternehmen ist dann handlungsfähig? Die Personalleitung? Die IT? Der Datenschutzbeauftragte? Ohne klare Verantwortlichkeitsstruktur entstehen im Ernstfall Lücken, die später als Compliance-Versagen ausgelegt werden.

Frage 3: Wie kommunizieren wir das nach innen und außen?

KI im Recruiting ist ein sensibles Thema für Bewerber, für Mitarbeitende und für Betriebsräte. Die schlechteste Strategie ist, Tools im Stillen einzusetzen und auf Beschwerden zu warten. Die bessere Strategie ist proaktive Transparenz: Welche Tools nutzen wir? Wofür? Wer prüft? Wie kann man widersprechen? Ein selbstbewusster Umgang stärkt das Vertrauen, ein verdeckter Einsatz untergräbt es.

Eine wichtige Grauzone: Wann wird HR zum Anbieter?

Viele HR-Abteilungen denken: Wir kaufen das Tool ein, also sind wir nur Betreiber. Das stimmt nur, solange das Tool unverändert eingesetzt wird. Wer ein Recruiting-Tool aber substanziell modifiziert, etwa indem es auf eigenen historischen Einstellungsdaten neu trainiert wird oder um Kriterien erweitert wird, die der Anbieter nicht vorgesehen hat, wird nach Art. 25 zum Anbieter im Sinne des AI Act, mit allen entsprechenden Pflichten (technische Dokumentation, Konformitätsbewertung, CE-Kennzeichnung, EU-Datenbank).

Auch der Einsatz einer generischen KI für HR-Zwecke kann diese Schwelle überschreiten. Wer auf einer LLM-API einen internen Bewerber-Assistenten aufsetzt, der Profile sortiert, ändert den bestimmungsgemäßen Zweck und wird damit vermutlich zum Anbieter eines Hochrisiko-Systems. Das ist eine erhebliche Verantwortungserweiterung, die in der Praxis oft übersehen wird.

Was jetzt konkret zu tun ist

Die meisten HR-Verantwortlichen müssen nicht alles auf einmal lösen, aber sie müssen anfangen. Eine pragmatische Reihenfolge:

Hinweis: Auch wenn das Digital Omnibus Paket die Hochrisiko-Pflichten möglicherweise auf den 2. Dezember 2027 verschiebt, gilt der Zeitplan oben weiterhin als Planungsgrundlage. Die KI-Kompetenzpflicht und die Transparenzpflichten sind unabhängig vom Omnibus bereits aktiv.

Zusammenfassung

KI im Recruiting und Personalmanagement ist Hochrisiko-Bereich nach EU AI Act, ohne Ausnahme, ohne Ermessensspielraum. Die Personalleitung steht damit vor einer Governance-Aufgabe, die nicht in der HR-Abteilung allein gelöst werden kann. Sie braucht klare Verantwortlichkeiten, eine systematische Bestandsaufnahme, strukturierte Anbieter-Prüfung, dokumentierte menschliche Aufsicht, transparente Kommunikation und ein laufendes Monitoring.

Die Unternehmen, die das jetzt strukturieren, gewinnen mehr als nur Compliance. Sie gewinnen Klarheit darüber, welche Tools welche Entscheidungen treffen, sie gewinnen Vertrauen bei Bewerbern und Mitarbeitenden, und sie reduzieren das Risiko von Diskriminierungsklagen, behördlichen Prüfungen und Bußgeldern.

Wer wartet, bis die erste Beschwerde kommt, hat den Moment verpasst, in dem Compliance noch eine Führungsentscheidung war. Dann wird sie eine Reaktion auf ein Problem.

KI im HR-Bereich strukturiert dokumentieren

SimpleAct macht aus der Compliance-Anforderung einen kontrollierten Prozess. KI-Inventar, Risikoklassifizierung, menschliche Aufsicht, Bewerber-Information, Audit-Trail. Alles an einem Ort.

Jetzt kostenlos starten →Dieser Beitrag dient der allgemeinen Information und stellt keine Rechtsberatung dar. Die Anforderungen können sich durch den Digital Omnibus on AI noch ändern. Stand: April 2026.

Über SimpleAct: SimpleAct ist eine deutsche Compliance-Plattform, die Unternehmen bei der strukturierten Dokumentation ihrer KI-Systeme nach EU AI Act unterstützt. Von der Erfassung über die Risikobewertung bis zum exportfähigen Audit-Nachweis. Alles an einem Ort.

Tags

Yannick | SimpleAct Team

Autor · SimpleAct Team